Das menschliche Gehirn lernt ständig dazu, während es bereits erworbene Kenntnisse bewahrt – ein Gleichgewicht, das Systeme der künstlichen Intelligenz (KI) noch immer nur schwer nachbilden können. Wenn ein KI-Modell neue Informationen aufnimmt, neigt es oft dazu, zuvor gelerntes Wissen zu löschen (katastrophales Vergessen) oder im Gegenteil zu starr zu werden, um neue Daten zu integrieren (katastrophales Erinnern).

Wissenschaftler des Centre de nanosciences et de nanotechnologies (C2N, CNRS/Universität Paris-Saclay), des CEA-Leti und des CEA-List ließen sich von den Neurowissenschaften inspirieren, wo neuere Arbeiten nahelegen, dass biologische Synapsen bayesschen Prinzipien folgen: Sie würden ihre Weltdarstellungen anpassen, indem sie neue Beobachtungen im Verhältnis zu früheren Kenntnissen gewichten und dabei ihren Grad an Unsicherheit berücksichtigen.

Auf dieser Grundlage schlug das Team einen neuen Rahmen für kontinuierliches Lernen vor, genannt Metaplastizität durch synaptische Unsicherheit (MESU).

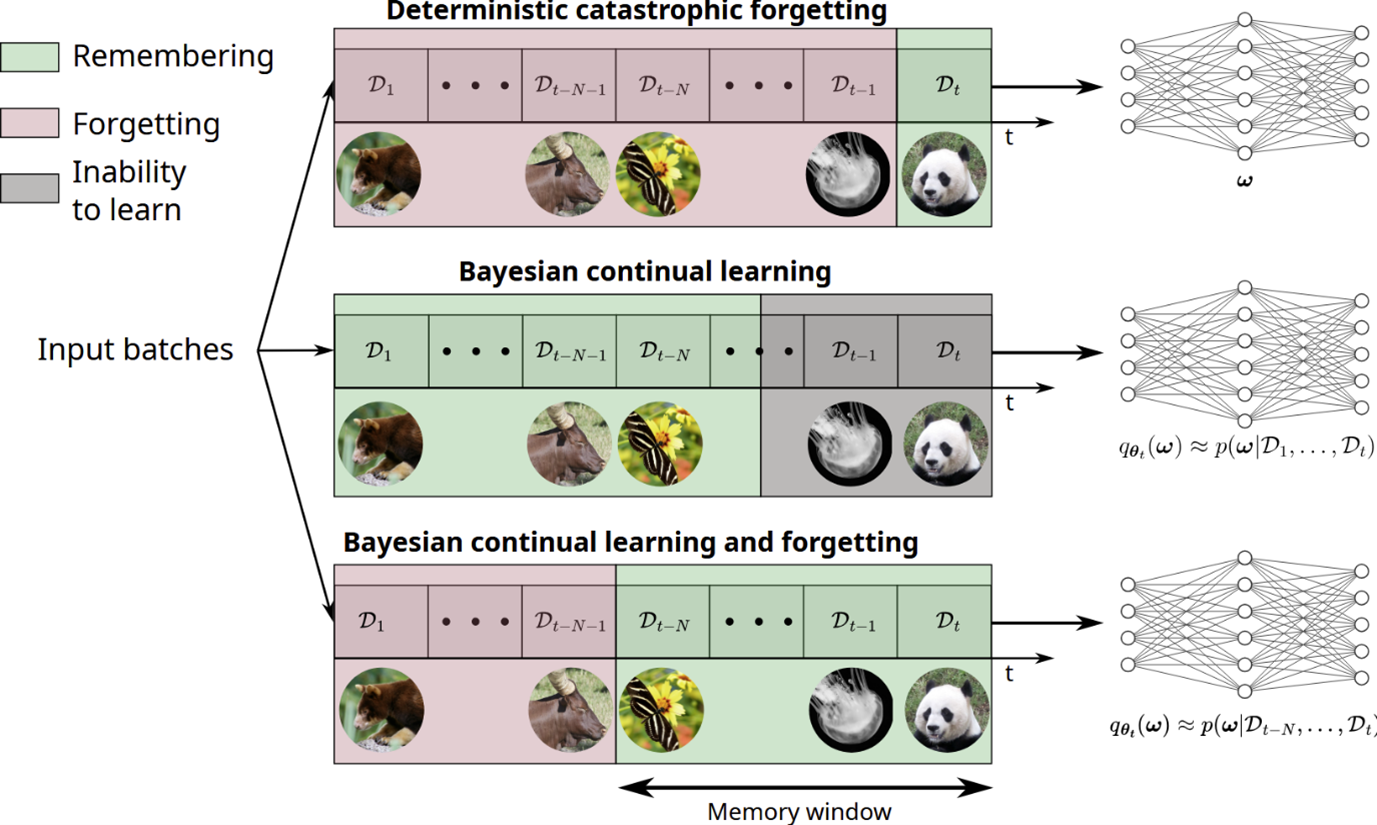

In MESU agiert jede Verbindung des Netzwerks wie eine bayessche Synapse, die ihre eigene Unsicherheitsschätzung aufrechterhält. Sie passt ihre Lernrate an das Vertrauen in die neuen Informationen an und integriert gleichzeitig einen Mechanismus des allmählichen Vergessens für Daten, die als weniger relevant erachtet werden. MESU übersetzt somit bestimmte neurowissenschaftliche Hypothesen darüber, wie das Gehirn Stabilität des Gedächtnisses und kognitive Flexibilität in Einklang bringt.

Die durchgeführten Experimente zeigten, dass MESU ein solides Gleichgewicht zwischen Behalten und Anpassung erreicht. Bei mehreren Datensätzen, darunter der Klassifikation von Tierbildern, der Erkennung permutierter Ziffern und dem inkrementellen Lernen von Objekten, reduziert MESU sowohl das Vergessen als auch die Starrheit des Lernens signifikant und liefert gleichzeitig zuverlässige Unsicherheitsschätzungen. Es übertrifft Methoden des kontinuierlichen Lernens, die auf expliziter Konsolidierung oder Aufgabenaufteilung beruhen.

Über diese Ergebnisse hinaus stellt MESU eine starke theoretische Verbindung zwischen Neurowissenschaften und maschinellem Lernen her, indem es einen vom Gehirn inspirierten Ansatz zur Bewältigung des kontinuierlichen Lernens formalisiert. Unser nächster Schritt wird darin bestehen, MESU auf probabilistische Modelle zu erweitern, die mit eingebetteter Hardware kompatibel sind, um dieses bio-inspirierte kontinuierliche Lernen auf reale KI-Geräte mit geringem Energieverbrauch anwendbar zu machen.

Kontinuierliches Lernen entspricht einer Situation des sequenziellen Trainings, bei der mehrere Datensätze nacheinander präsentiert werden. Im Rahmen von MESU folgen die Gewichte des neuronalen Netzes einer Wahrscheinlichkeitsverteilung, die eine Formulierung ermöglicht, die Lernen und Vergessen harmonisch vereint – im Gegensatz zu früheren Methoden.

© Damien Querlioz, C2N