ELIZA - Définition

La liste des auteurs de cet article est disponible ici.

Introduction

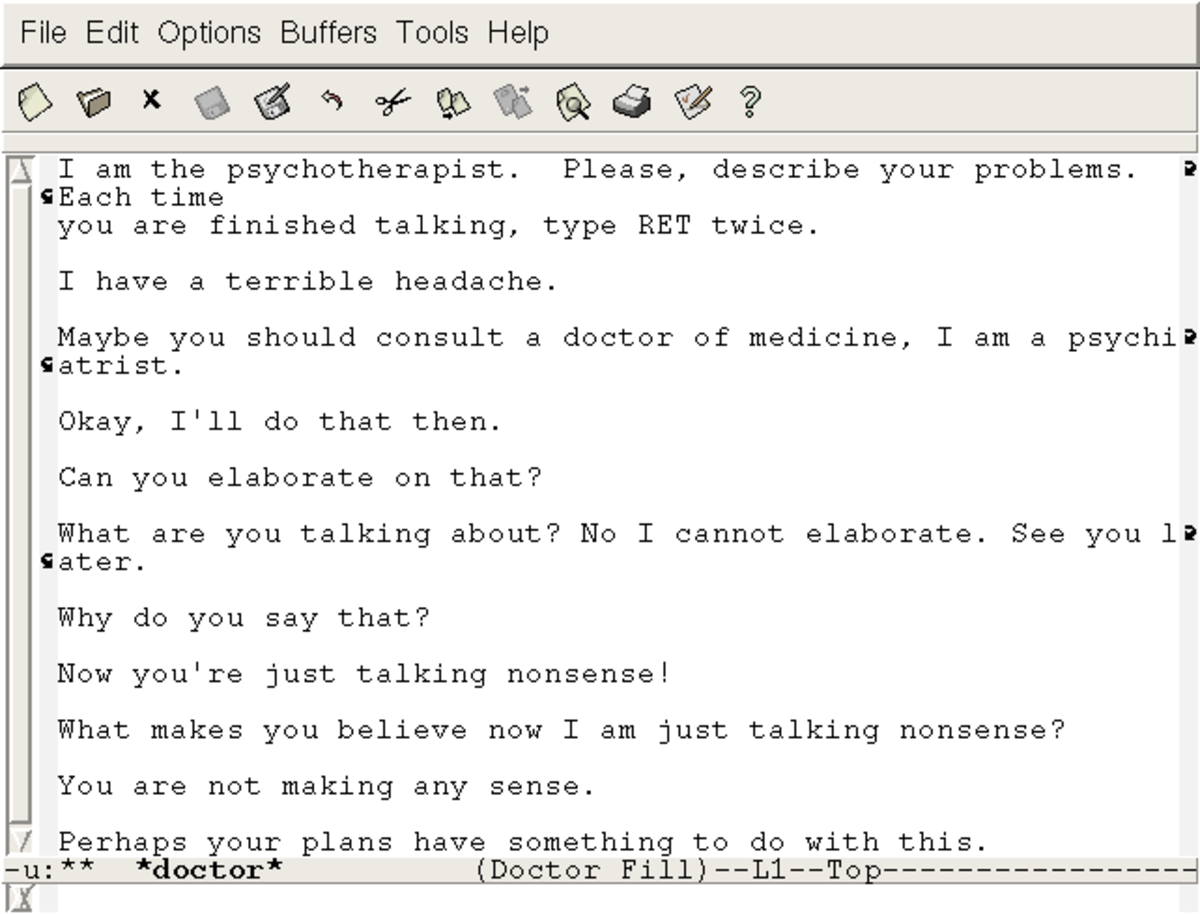

ELIZA est un célèbre programme informatique écrit par Joseph Weizenbaum en 1966, qui simulait un psychothérapeute rogérien en reformulant la plupart des affirmations du « patient » en questions, et en les lui posant.

Les limites d'ELIZA

ELIZA fonctionnait par simple reconnaissance de formes et substitution des mots-clés dans les phrases produites. Typiquement, une affirmation « A » peut recevoir en retour la question « Pourquoi dites-vous que A ? ». Quelques connaissances de rattachement entre mots lui permettaient de renvoyer l’interlocuteur à un sujet plus large. « Parlez-moi de votre famille » est la réponse donnée à toute question comportant un mot-clé comme « mère » ou « fils ». À noter que ces transformations sont plus simples en anglais, langue de fonctionnement d’ELIZA.

Weizenbaum insiste dans son livre sur le fait que même si Eliza écrit « Je comprends… » à titre de protocole de politesse programmé envers l’interlocuteur, il s’agit évidemment d’une déclaration abusive : Eliza ne comprend en réalité rien du tout de ce qui lui est transmis, il se contente de former des phrases à partir de modèles pré établis, enrichis par les mots clés trouvés dans les réponses du patient. Dit par ELIZA, « je comprends » possède en fait une connotation ironique : il s’agit en effet d’une de ses réponses à utiliser quand il n’a rien trouvé dans la phrase précédente lui permettant de construire une réponse plus adaptée (voir la chambre chinoise de John Searle pour le problème de la compréhension).

ELIZA se contente de relancer son interlocuteur, contrairement aux agents conversationnels de renseignement, qui sont conçus pour donner des réponses utiles en utilisant sa base de données.

Le test de Turing

Le critère de pouvoir parler avec un humain sans qu’il se rende compte qu’il a affaire à un ordinateur a été posé en critère d’intelligence artificielle.

ELIZA montre qu’il est possible de tromper certains humains avec des schémas logiques extrêmement simples. Le test de Turing serait-il inapproprié pour déterminer qu’un ordinateur pense ? La question n’a pas été tranchée, car après tout, il reste relativement aisé de trouver des questions auxquelles l’ordinateur ne saurait répondre de manière intelligente, ou en tout cas pas avec des programmes de type ELIZA. Exemples de questions difficiles :

- « Peut-on manger demain avec un ami décédé l’année dernière et pourquoi ? »

- « Que représente pour moi le frère de mon père ? »

- « X pèse 50 kg, Y pèse 70 kg, Z pèse 60 kg. Qui est le plus lourd ? »

Un programme écrit en Perl ou en Prolog (ou une combinaison des deux) pourrait être écrit pour répondre à chacune de ces trois questions, voire aux trois, mais la complexité du programme augmenterait au moins linéairement avec le nombre de questions possibles, et celui-ci ne pourrait donc prétendre à la généralité

Impression des interlocuteurs

ELIZA était si convaincant qu’il y a beaucoup d’anecdotes à propos de gens qui devenaient de plus en plus dépendants émotionnellement de leur relation avec ELIZA. On peut tout d’abord expliquer cela par la tendance humaine naturelle à attacher aux mots un/des sens que l’ordinateur ne pouvait y avoir mis.

On remarque aussi que la grande faiblesse d’ELIZA, être incapable de répondre quoi que ce soit, se contentant de continuer à faire parler son interlocuteur, était en fait un atout. Certaines personnes ne souhaitent pas vraiment qu’on leur réponde, et ne remarquent pas si leur interlocuteur les comprend. Il suffit de leur donner l’impression qu’elles sont écoutées.