Moindres carrés non linéaires - Définition

La liste des auteurs de cet article est disponible ici.

Minimums multiples

On peut trouver plusieurs minimums de S dans certaines circonstances:

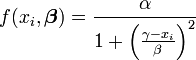

- Un paramètre intervenant à une certaine puissance. Par exemple, pour ajuster des données à une courbe de Lorentz:

Il y a alors deux solution pour le paramètre β:

- Deux paramètres peuvent s'interchanger sans changer le critère. Par exemple, cela survient lorsqu'on rencontre le produit de deux paramètres: ainsi αβ donnera la même chose que βα;

- Un paramètre intervient dans une fonction périodique, comme par exemple dans

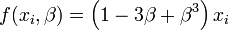

Tous les minimums multiples ne donnent pas la même valeur de la fonction objectif. Un autre problème concerne les minimums locaux. Par exemple, dans le modèle

il y a un minimum local en

Pour être certain d'avoir obtenu un minimum global, il est souhaitable de recommencer la procédure de minimisation en changeant le point de départ. Quand on obtient le même résultat quel que soit le point de départ, on peut alors penser obtenir un minimum global.

L'existence de minimums multiples a une conséquence importante: la fonction objectif admet une valeur maximum quelque part entre les deux minimums. Les équations normales en ce maximum fait intervenir des matrices non définies positives. Une telle situation est à proscrire, en particulier comme initialisation du procédé itératif. Par exemple, pour le cas de l'ajustement du modèle de Lorentz, le cas β = 0 est à éviter.

Astuces calculatoires

Choix du vecteur d'incrément

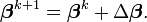

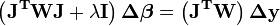

Dans le procédé itératif

il est impératif de se prémunir contre la divergence. Plusieurs astuces concernant le choix de

- changer sa norme sans pour autant changer sa direction. On peut alors introduire une proportion f (entre 0 et 1) et amender le procédé itératif en

- si la direction de l'incrément est trop éloigné de sa direction "optimale" et que la méthode précédente échoue, il faudra peut-être changer légèrement la direction du vecteur d'incrément

Décompositions

QR

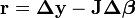

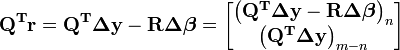

Le minimum de la somme des carrés des résidus peut se trouver sans former les équations normales. Les résidus du modèle linéarisé s'écrivent

La jacobienne fait l'objet d'une décomposition orthogonale, comme par exemple la Décomposition QR:

où Q est une matrice orthogonale

Le vecteur de résidu est pré-multiplié par

La somme des carrés reste inchangée puisque

La résolution est facile d'accès car la matrice R a été prise triangulaire supérieure.

Décomposition en valeurs singulières

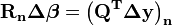

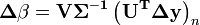

Une variante de la méthode précédente fait intervenir la Décomposition en valeurs singulières, dans laquelle R est diagonalisée:

où

La relative simplicité de cette expression est très utile dans l'analyse théorique des moindres carrés. Cette méthode est largement détaillée dans Lawson et Hanson..

Critères de convergence

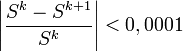

Le critère de convergence le plus immédiat est que la somme des carrés ne doit pas décroître d'une itération à l'autre. Ce critère est souvent difficile à implémenter. Aussi, on préfère le critère de convergence suivant

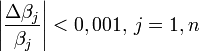

Évidemment, la valeur 0,0001 est arbitraire et doit être changée. En particulier, il faudra augmenter cette valeur lorsque les erreurs expérimentales sont importantes. Un critère alternatif est

Là encore, la valeur numérique est arbitraire.