Autocorrélation - Définition

La liste des auteurs de cet article est disponible ici.

Introduction

L'autocorrélation est un outil mathématique souvent utilisé en traitement du signal. C'est la corrélation croisée d'un signal par lui-même. L'autocorrélation permet de détecter des régularités, des profils répétés dans un signal comme un signal périodique perturbé par beaucoup de bruit, ou bien une fréquence fondamentale d'un signal qui ne contient pas effectivement cette fondamentale, mais l'implique avec plusieurs de ses harmoniques.

Définitions

Généralités

Note : La confusion est souvent faite entre l'autocovariance et l'autocorrélation obtenue en divisant cette dernière par la variance. Ces deux notions généralisent les notions classiques de covariance ayant pour dimension la dimension de la variable élevée au carré et de coefficient de corrélation compris entre -1 et +1. Les considérations qui suivent utilisent le langage le plus répandu chez les praticiens, sans division par la variance. Il existe d'autre part deux définitions fondamentalement différentes.

À un processus stochastique discret ou continu, correspond une « autocorrélation » statistique qui généralise la notion de covariance. Dans le cas d'un processus continu (en toute généralité complexe)

![R_X(t1,t2) = E[X(t1).X^*(t2)]\,](https://static.techno-science.net/illustration/Definitions/autres/3/3267502357feb4aba8ec36b73daac32f_23ed98fb043ca217aafa0140d68a0355.png)

Dans le cas d'un signal stationnaire, on peut écrire :

![R_X(\tau) = E[X(t).X^*(t-\tau)]\,](https://static.techno-science.net/illustration/Definitions/autres/c/cffddf8ad3cc732d820f8fbfdcce543c_92c69175e75c73310105ab5ce84ecd2b.png)

À partir d'un signal

Lorsque le signal est considéré comme réalisation d'un processus stationnaire ergodique, l'autocorrélation temporelle est identique à l'autocorrélation statistique. Elle peut être utilisée pour calculer le contenu en fréquence du signal (voir densité spectrale).

Dans certains problèmes, elle permet d'analyser le signal sans référence à son contenu en fréquences.

Statistiques

En statistique, l'autocorrélation d'une série temporelle discrète ou d'un processus Xt est simplement la corrélation du processus par rapport à une version décalée dans le temps de lui-même. Si Xt est un processus stationnaire d'espérance μ alors la définition est

où E est l'espérance mathématique et k est le décalage temporel, σ2 est la variance (statistiques et probabilités) et μ la moyenne de la série. C'est une fonction à valeur dans l'intervalle [−1, 1] avec 1 indiquant une parfaite corrélation (Les signaux se recouvrent exactement quand le temps est décalé de k) et −1 indiquant une parfaite anti-corrélation. Il est d'usage pratique dans de nombreuses disciplines de tracer la normalisation par σ2 et d'utiliser le terme autocorrélation sans distinction avec celui d'autocovariance.

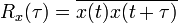

Traitement du Signal

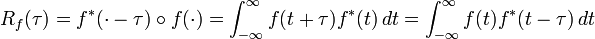

En traitement du signal, pour un signal donné f(t), l'autocorrélation continue Rf(τ) est la corrélation croisée continue de f(t) avec elle-même, à l'intervalle de temps τ, et est définie comme:

où f* représente le conjugué complexe et le cercle représente l'opération de convolution. Pour une fonction réelle, f* = f.

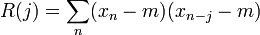

Formellement, l'autocorrélation discrète R pour l'intervalle de temps j et le signal xn est

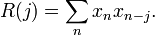

où m est la valeur moyenne (valeur attendue) de xn. Souvent, les autocorrélations sont calculées pour un signal centré sur zéro. C’est-à-dire un signal dont la valeur moyenne est nulle. L'autocorrélation est alors définie par

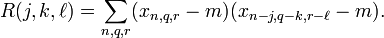

L'autocorrélation multi-dimensionelle est définie de manière similaire. Par exemple, en trois dimensions l'autocorrélation devient

![R(k) = \frac{E[(X_i - \mu)(X_{i+k} - \mu)]}{\sigma^2}](https://static.techno-science.net/illustration/Definitions/autres/b/b649019848cf9ea45681a1f74712992a_bf485cfe7e5252c9962035888ee6b511.png)