Théorème du rang - Définition

La liste des auteurs de cet article est disponible ici.

Introduction

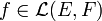

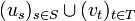

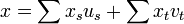

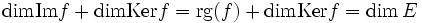

En mathématiques, le théorème du rang de l'algèbre linéaire, lie le rang et la dimension du noyau d'une application linéaire. Soient E et F deux espaces vectoriels sur un corps K et soit

-

où rgf désigne la dimension de l'image de f.

Pour démontrer le théorème, on vérifie que pour toute base

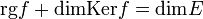

Cas particulier des endomorphismes

Soit f une application linéaire d'un espace vectoriel E dans lui-même. On a la relation:

-

Autres formulations et généralisations

Ce théorème est une forme du premier théorème d'isomorphisme de l'algèbre dans le cas des espaces vectoriels.

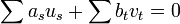

Dans un langage plus moderne, le théorème peut être énoncé de la manière suivante : si

est une suite exacte courte d'espaces vectoriels, alors

- dim(D) + dim(F) = dim(E)

Ici F joue le rôle de Imf et D celui de Kerf.

En dimension finie, cette formulation peut être généralisée : si

est une suite exacte d'espaces vectoriels de dimension finie, alors

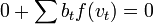

Le théorème du rang pour des espaces vectoriels de dimension finie peut aussi être formulé en termes d'indice d'application linéaire. L'indice d'une application linéaire

- indicef = dim(Kerf) − dim(Cokerf) où Coker désigne le conoyau de f.

Intuitivement, Kerf est le nombre de solutions indépendantes x de l'équation f(x) = 0, et dim(Cokerf) est le nombre de restrictions indépendantes qui doivent être mises à la place de y pour rendre l'équation f(x) = y résoluble. Le théorème du rang pour des espaces vectoriels de dimension finie est équivalent à la proposition

- indicef = dim(E) − dim(F)

Nous voyons que nous pouvons facilement déterminer l'indice d'une application linéaire f à partir des espaces impliqués, sans nul besoin d'étudier f en détail. Cela se remarque également dans un résultat beaucoup plus profond : le théorème de l'indice d'Atiyah-Singer qui affirme que l'indice de certains opérateurs différentiels peut être obtenu à partir de la géométrie des espaces impliqués.