Intelligence artificielle - Définition

La liste des auteurs de cet article est disponible ici.

Introduction

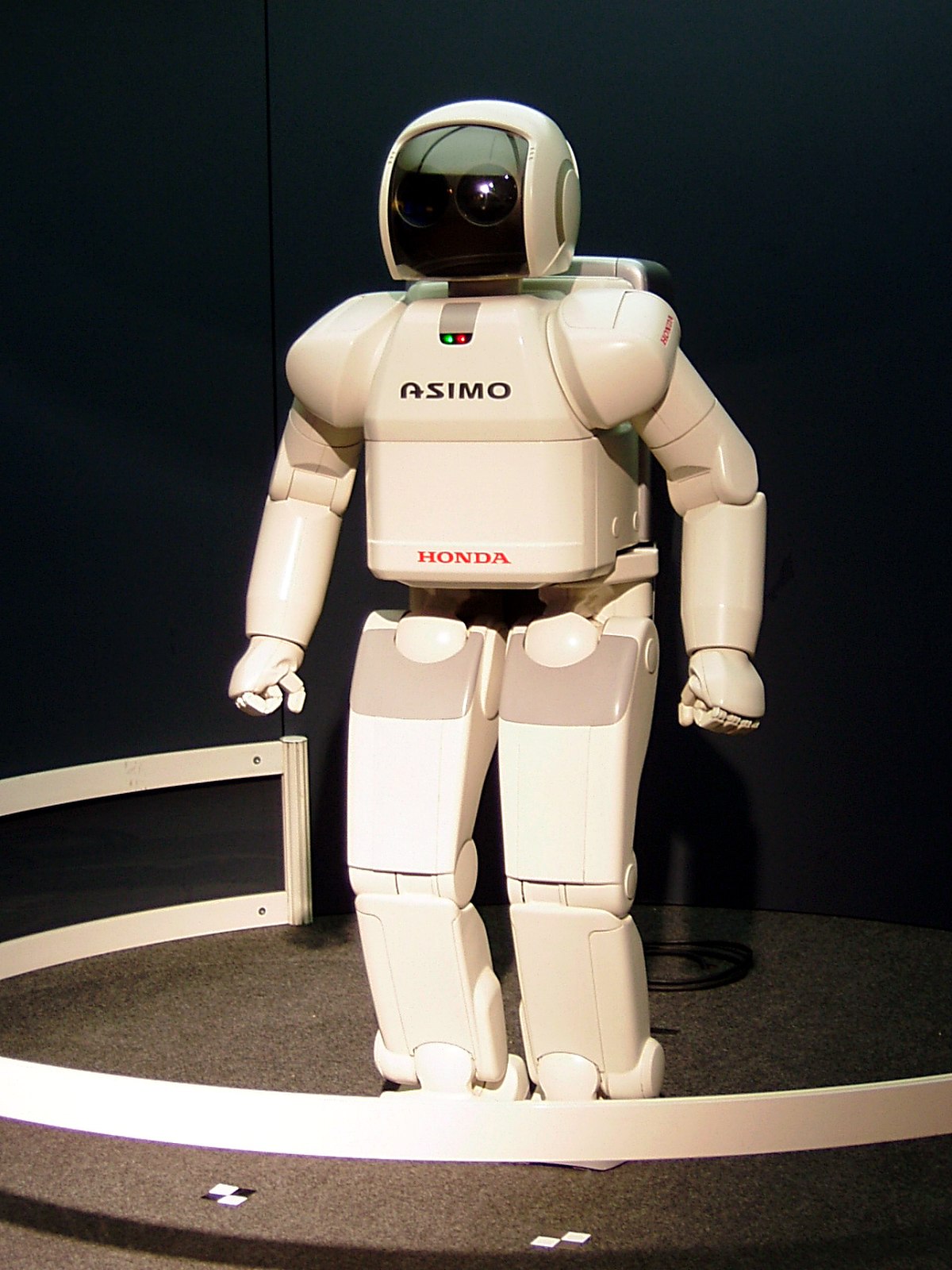

L'intelligence artificielle ou informatique cognitive est la « recherche de moyens susceptibles de doter les systèmes informatiques de capacités intellectuelles comparables à celles des êtres humains ».

Définition

Le terme intelligence artificielle, créé par John McCarthy, est souvent abrégé par le sigle IA. Il est défini par l’un de ses créateurs, Marvin Lee Minsky, comme « la construction de programmes informatiques qui s’adonnent à des tâches qui sont, pour l’instant, accomplies de façon plus satisfaisante par des êtres humains car elles demandent des processus mentaux de haut niveau tels que : l’apprentissage perceptuel, l’organisation de la mémoire et le raisonnement critique ». On y trouve donc le côté « artificiel » atteint par l'usage des ordinateurs ou de processus électroniques élaborés et le côté « intelligence » associé à son but d'imiter le comportement. Cette imitation peut se faire dans le raisonnement, par exemple dans les jeux ou la pratique de mathématiques, dans la compréhension des langues naturelles, dans la perception : visuelle (interprétation des images et des scènes), auditive (compréhension du langage parlé) ou par d'autres capteurs, dans la commande d'un robot dans un milieu inconnu ou hostile.

Même si elles respectent globalement la définition de Minsky, il existe un certain nombre de définitions différentes de l'IA qui varient sur deux points fondamentaux :

- Les définitions qui lient la définition de l'IA à un aspect humain de l'intelligence, et celles qui la lient à un modèle idéal d'intelligence, non forcément humaine, nommée rationalité.

- Les définitions qui insistent sur le fait que l'IA a pour but d'avoir toutes les apparences de l'intelligence (humaine ou rationnelle), et celles qui insistent sur le fait que le fonctionnement interne du système IA doit ressembler également à celui de l'être humain ou être rationnel.

Intelligence artificielle forte

Définition

Le concept d’intelligence artificielle forte fait référence à une machine capable non seulement de produire un comportement intelligent, mais d’éprouver une impression d'une réelle conscience de soi, de « vrais sentiments » (quoi qu’on puisse mettre derrière ces mots), et « une compréhension de ses propres raisonnements ».

L’intelligence artificielle forte a servi de moteur à la discipline, mais a également suscité de nombreux débats. En se fondant sur le constat que la conscience a un support biologique et donc matériel, la plupart des scientifiques ne voient pas d’obstacle de principe à créer un jour une intelligence consciente sur un support matériel autre que biologique. Selon les tenants de l'IA forte, si à l'heure actuelle il n'y a pas d'ordinateurs ou de robots aussi intelligents que l'être humain, ce n'est pas un problème d'outil mais de conception. Il n'y aurait aucune limite fonctionnelle (un ordinateur est une machine de Turing universelle avec pour seules limites les limites de la calculabilité), il n'y aurait que des limites liées à l'aptitude humaine à concevoir le programme approprié. Elle permet notamment de modéliser des idées abstraites.

Estimation de faisabilité

On peut être tenté de comparer la capacité de traitement de l'information d'un cerveau humain à celle d'un ordinateur pour estimer la faisabilité d'une IA forte. Il s'agit cependant d'un exercice purement spéculatif, et la pertinence de cette comparaison n'est pas établie. Cette estimation très grossière est surtout destinée à préciser les ordres de grandeur en présence.

Un ordinateur typique de 1970 effectuait 107 opérations logiques par seconde, et occupait donc - géométriquement - une sorte de milieu entre une balance de Roberval (1 opération logique par seconde) et le cerveau humain (grossièrement 2 x 1014 opérations logiques par seconde, car formé de 2 x 1012 neurones ne pouvant chacun commuter plus de 100 fois par seconde).

En 2005, un microprocesseur typique traite 64 bits en parallèle (128 dans le cas de machines à double cœur) à une vitesse typique de 2 GHz, ce qui place en puissance brute dans les 1011 opérations logiques par seconde. En ce qui concerne ces machines destinées au particulier, l'écart s'est donc nettement réduit. En ce qui concerne les machines comme Blue Gene, il a même changé de sens.

Le matériel serait donc maintenant présent. Du logiciel à la mesure de ce matériel resterait à développer. En effet, l'important n'est pas de raisonner plus vite, en traitant plus de données, ou en mémorisant plus de choses que le cerveau humain, l'important est de traiter les informations de manière appropriée.

L'IA souligne la difficulté à expliciter toutes les connaissances utiles à la résolution d'un problème complexe. Certaines connaissances dites implicites sont acquises par l'expérience et mal formalisables. Par exemple, qu'est-ce qui distingue un visage familier de deux cents autres ? Nous ne savons clairement l'exprimer.

L'apprentissage de ces connaissances implicites par l'expérience semble une voie prometteuse (voir Réseau de neurones). Néanmoins, un autre type de complexité apparaît, la complexité structurelle. Comment mettre en relation des modules spécialisés pour traiter un certain type d'informations, par exemple un système de reconnaissance des formes visuelles, un système de reconnaissance de la parole, un système lié à la motivation, à la coordination motrice, au langage, etc. En revanche, une fois un tel système conçu et un apprentissage par l'expérience réalisé, l'intelligence du robot pourrait probablement être dupliquée en grand nombre d'exemplaires.

Diversité des opinions

Les principales opinions soutenues pour répondre à la question d’une intelligence artificielle consciente sont les suivantes :

- Impossible : la conscience serait le propre des organismes vivants, et elle serait liée à la nature des systèmes biologiques. Cette position est défendue principalement par des philosophes et des religieux.

- Problème : Elle rappelle toutefois toutes les controverses passées entre vitalistes et matérialistes, l'histoire ayant à plusieurs reprises infirmé les positions des premiers.

- Impossible avec des machines manipulant des symboles comme les ordinateurs actuels, mais possible avec des systèmes dont l’organisation matérielle serait fondée sur des processus quantiques. Cette position est défendue notamment par Roger Penrose. Des algorithmes quantiques sont théoriquement capables de mener à bien des calculs hors de l'atteinte pratique des calculateurs conventionnels (complexité en

- Problème : On ne dispose pas encore pour le moment d'algorithmes d'IA à mettre en œuvre dessus. Tout cela reste donc spéculatif.

- Impossible avec des machines manipulant des symboles comme les ordinateurs actuels, mais possible avec des systèmes dont l’organisation matérielle mimerait le fonctionnement du cerveau humain, par exemple avec des circuits électroniques spécialisés reproduisant le fonctionnement des neurones.

- Problème : Le système en question répondant exactement de la même façon que sa simulation sur ordinateur - toujours possible - au nom de quel principe leur assigner une différence ?

- Impossible avec les algorithmes classiques manipulant des symboles (logique formelle), car de nombreuses connaissances sont difficiles à expliciter mais possible avec un apprentissage par l'expérience de ces connaissances à l'aide d'outils tels que des réseaux de neurones formels, dont l'organisation logique et non matérielle s'inspire des neurones biologiques, et utilisés avec du matériel informatique conventionnel.

- Problème : si du matériel informatique conventionnel est utilisé pour réaliser un réseau de neurones, alors il est possible de réaliser l'IA avec les ordinateurs classiques manipulant des symboles (puisque ce sont les mêmes machines, voir Thèse de Church-Turing). Cette position parait donc incohérente. Toutefois, ses défenseurs (thèse de l'IA forte) arguent que l'impossibilité en question est liée à notre inaptitude à tout programmer de manière explicite, elle n'a rien à voir avec une impossibilité théorique. Par ailleurs, ce que fait un ordinateur, un système à base d'échanges de bouts de papier dans une salle immense peut le simuler quelques milliards de fois plus lentement. Or il peut rester difficile à admettre que cet échange de bouts de papiers « ait une conscience ». Voir Chambre chinoise. Selon les tenants de l'IA forte, cela ne pose toutefois pas de problème.

- Impossible car la pensée n'est pas un phénomène calculable par des processus discrets et finis. Pour passer d'un état de pensée au suivant, il y a une infinité non dénombrable, une continuité d'états transitoires. Cette idée est réfutée par Alain Cardon (Modéliser et concevoir une Machine pensante).

- Possible avec des ordinateurs manipulant des symboles. La notion de symbole est toutefois à prendre au sens large. Cette option inclut les travaux sur le raisonnement ou l'apprentissage symbolique basé sur la logique des prédicats, mais aussi les techniques connexionnistes telles que les réseaux de neurones, qui, à la base, sont définies par des symboles. Cette dernière opinion constitue la position la plus engagée en faveur de l'intelligence artificielle forte.

Des auteurs comme Hofstadter (mais déjà avant lui Arthur C. Clarke ou Alan Turing) (voir le test de Turing) expriment par ailleurs un doute sur la possibilité de faire la différence entre une intelligence artificielle qui éprouverait réellement une conscience, et une autre qui simulerait exactement ce comportement. Après tout, nous ne pouvons même pas être certains que d’autres consciences que la nôtre (chez des humains s’entend) éprouvent réellement quoi que ce soit. On retrouve là le problème connu du solipsisme en philosophie.

Travaux complémentaires

- Le mathématicien de la physique Roger Penrose pense que la conscience viendrait de l'exploitation de phénomènes quantiques dans le cerveau (voir microtubules), empêchant la simulation réaliste de plus de quelques dizaines de neurones sur un ordinateur normal, d’où les résultats encore très partiels de l’IA. Il restait jusqu’à présent isolé sur cette question. Un autre chercheur a présenté depuis une thèse de même esprit quoique moins radicale : Andrei Kirilyuk

- Cette spéculation reste néanmoins marginale par rapport aux travaux des neurosciences. L'action de phénomènes quantiques est évidente dans le cas de la rétine (quelques quanta de lumière seulement suffisent à une perception) ou de l'odorat, mais elle ne constitue pas une condition préalable à un traitement efficace de l'information. En effet, le traitement de l'information effectué par le cerveau est relativement robuste et ne dépend pas de l'état quantique de chaque molécule, ni même de la présence ou de la connexion de neurones isolés.

Cela dit, l’intelligence artificielle est loin de se limiter aux seuls réseaux de neurones, qui ne sont généralement utilisés que comme classifieurs. Les techniques de résolution générale de problèmes et la logique des prédicats, entre autres, ont fourni des résultats spectaculaires et sont exploités par les ingénieurs dans de nombreux domaines.