Loi de Cauchy - Définition

La liste des auteurs de cet article est disponible ici.

Introduction

| Cauchy | |

|---|---|

| |

| |

| | |

| Paramètres |

Paramètre d'échelle (réel) Paramètre d'échelle (réel) |

| Support |

|

| Densité de probabilité (fonction de masse) |

![\frac{1}{\pi a\,\left[1 + \left(\frac{x-x_0}{a}\right)^2\right]} \!](https://static.techno-science.net/illustration/Definitions/autres/4/43f56f2dc73ea351d25e94bca2e6826b_f322bf7ef486124e547250fa3d9c01d1.png)

|

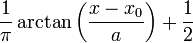

| Fonction de répartition |

|

| Espérance | non définie |

| Médiane (centre) | x0 |

| Mode | x0 |

| Variance | non définie |

| Asymétrie (statistique) | non définie |

| Kurtosis (non-normalisé) | non définie |

| Entropie |

|

| Fonction génératrice des moments | non définie |

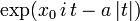

| Fonction caractéristique |

|

| modifier | |

La loi de Cauchy, appelée aussi loi de Lorentz, est une loi de probabilité classique qui doit son nom au mathématicien Augustin Louis Cauchy.

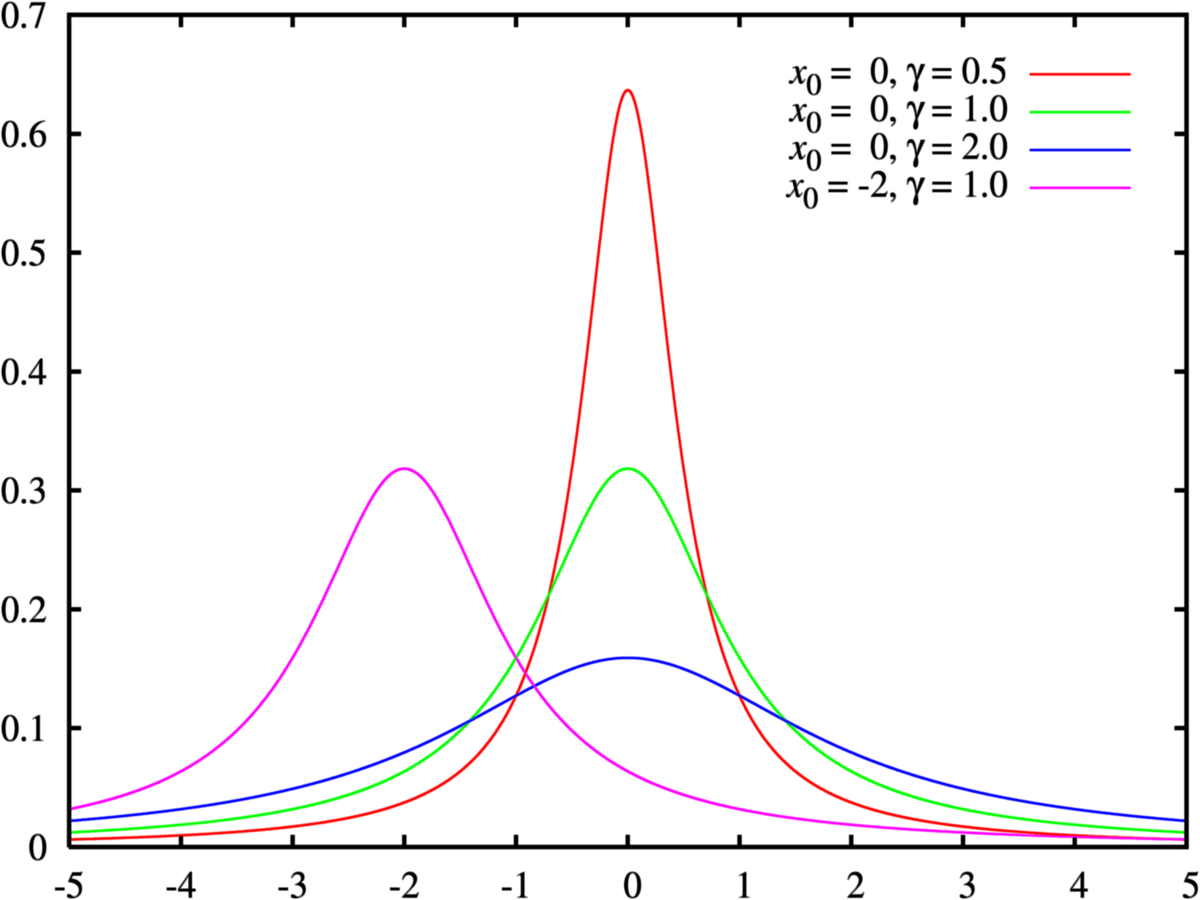

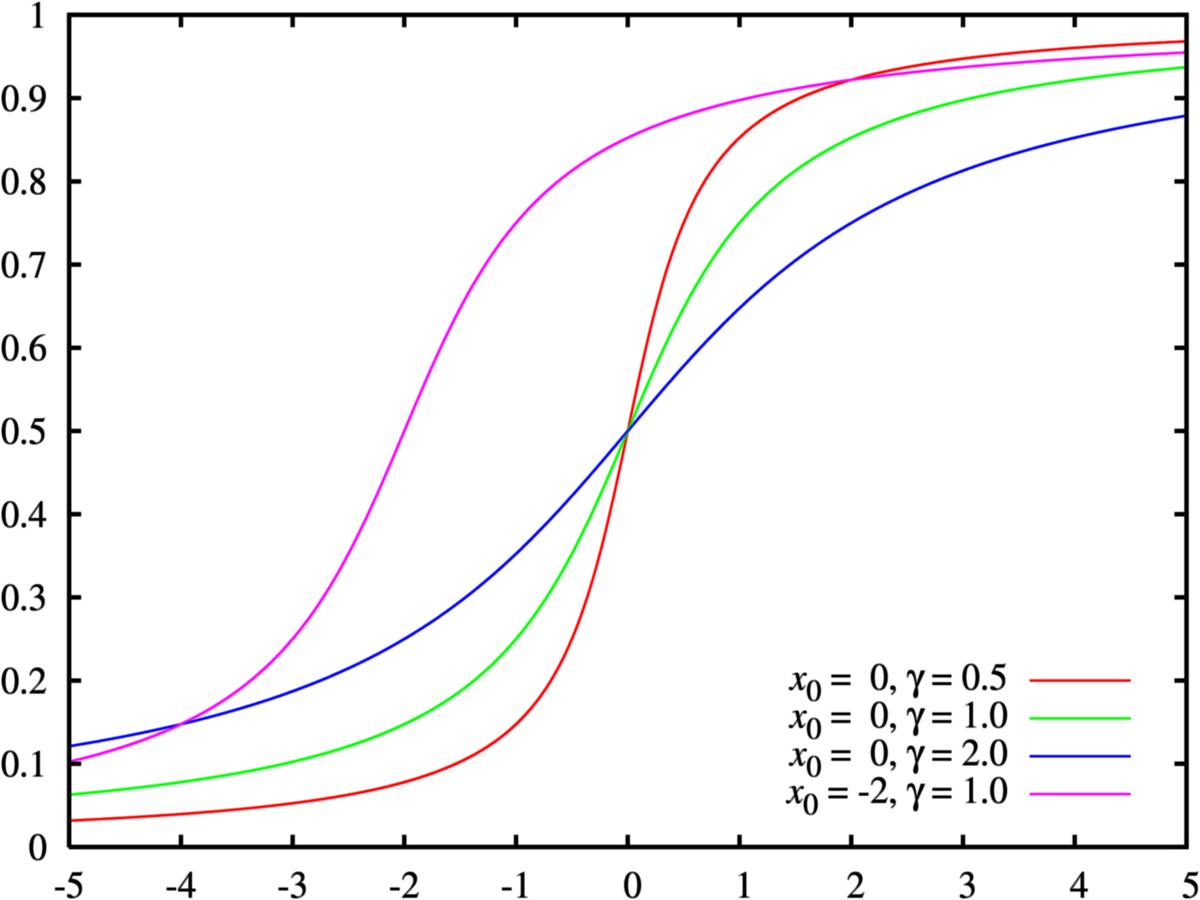

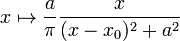

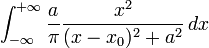

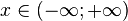

Une variable aléatoire X suit une loi de Cauchy si elle admet une densité fX par rapport à la mesure de Lebesgue, dépendant des deux paramètres x0 et a (a > 0) et définie par :

Cette distribution est symétrique par rapport à x0 (Paramètre de location), le paramètre a donnant une information sur l'étalement de la fonction (Paramètre d'échelle).

L'inverse d'une variable aléatoire, de loi de Cauchy, suit une loi de Cauchy.

Le quotient de deux variables aléatoires réelles indépendantes suivant des loi normales standards suit une loi de Cauchy.

Espérance et écart type

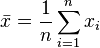

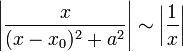

La loi de Cauchy n'admet ni espérance ni écart type. Et il en va de même pour tout moment d'ordre supérieur. En effet,

car

A fortiori, la loi de Cauchy n'admet pas d'écart type (

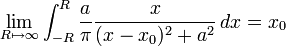

Cependant, x0, qui en est la médiane, est souvent considéré comme la "moyenne" de la loi de Cauchy, car :

Loi de Cauchy et théorèmes limite

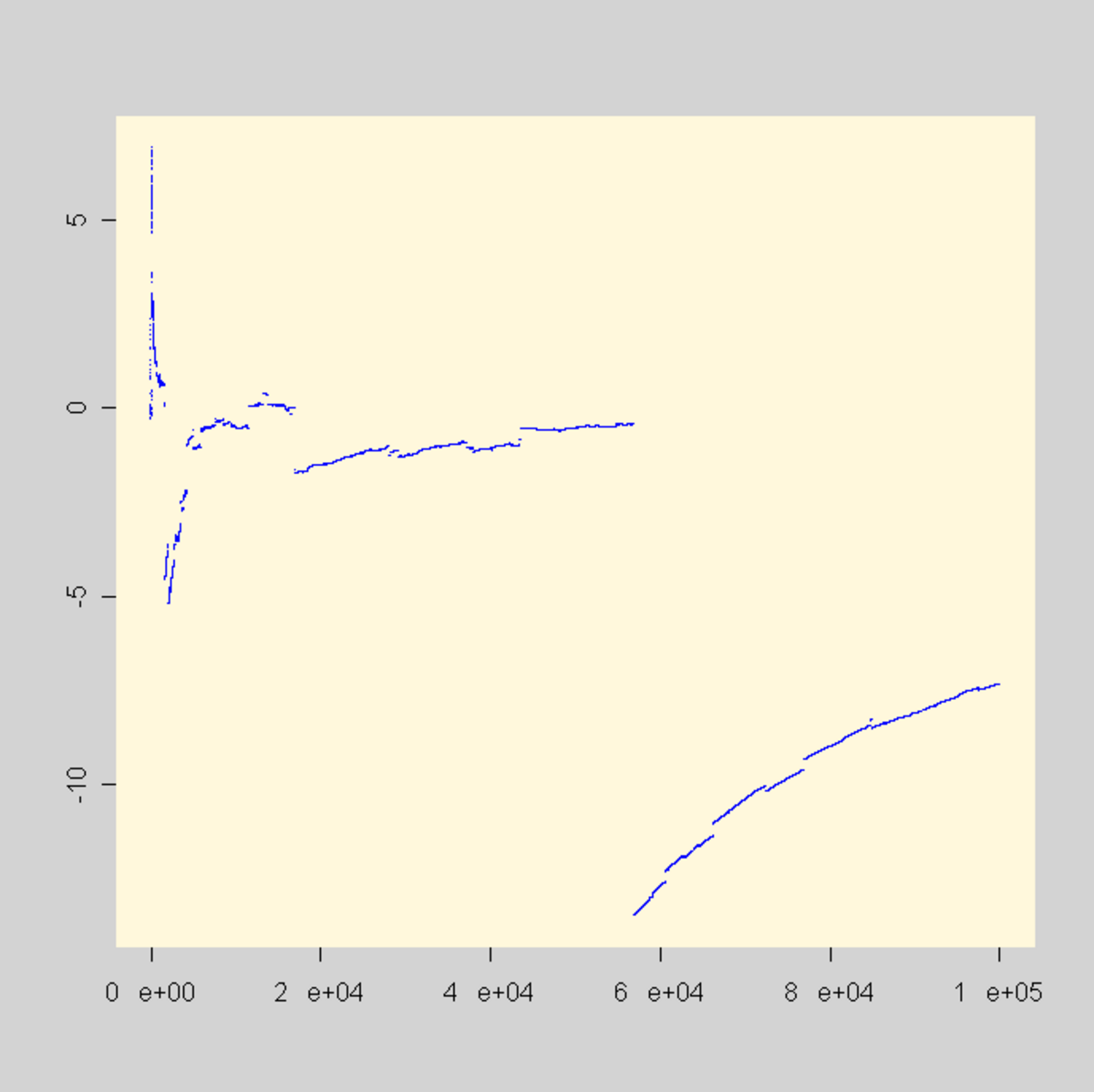

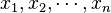

La loi de Cauchy est l'une de celles auxquelles la Loi des grands nombres ne s'applique pas: partant d'un échantillon d'observations

ne converge pas vers une quantité déterministe (à savoir l'espérance de la loi). Au contraire, cette moyenne reste aléatoire: elle est elle-même distribuée selon une loi de Cauchy.

Elle nous montre ainsi que la condition de l'espérance définie selon l'intégrale de Lebesgue est indispensable à l'application de la loi. On remarque que les valeurs moyennes s'approchent de xo mais il arrive toujours un moment où une valeur trop éloignée "empêche" la moyenne de converger. La probabilité d'obtenir des valeurs éloignées de x0 est en fait trop élevée pour permettre à la moyenne empirique de converger.

![\begin{align} f(x; x_0,a) &= \frac{1}{\pi a \left[1 + \left(\frac{x-x_0}{a}\right)^2\right]} \\[0.5em] &= { 1 \over \pi } \left[ { a \over (x - x_0)^2 + a^2 } \right] \end{align}](https://static.techno-science.net/illustration/Definitions/autres/1/13e80793b87a032ab16d281c5451d576_bf42b3e6c2f7f23169a4e5dc824727e8.png)