Équation - Définition

La liste des auteurs de cet article est disponible ici.

Systèmes dynamiques

Introduction

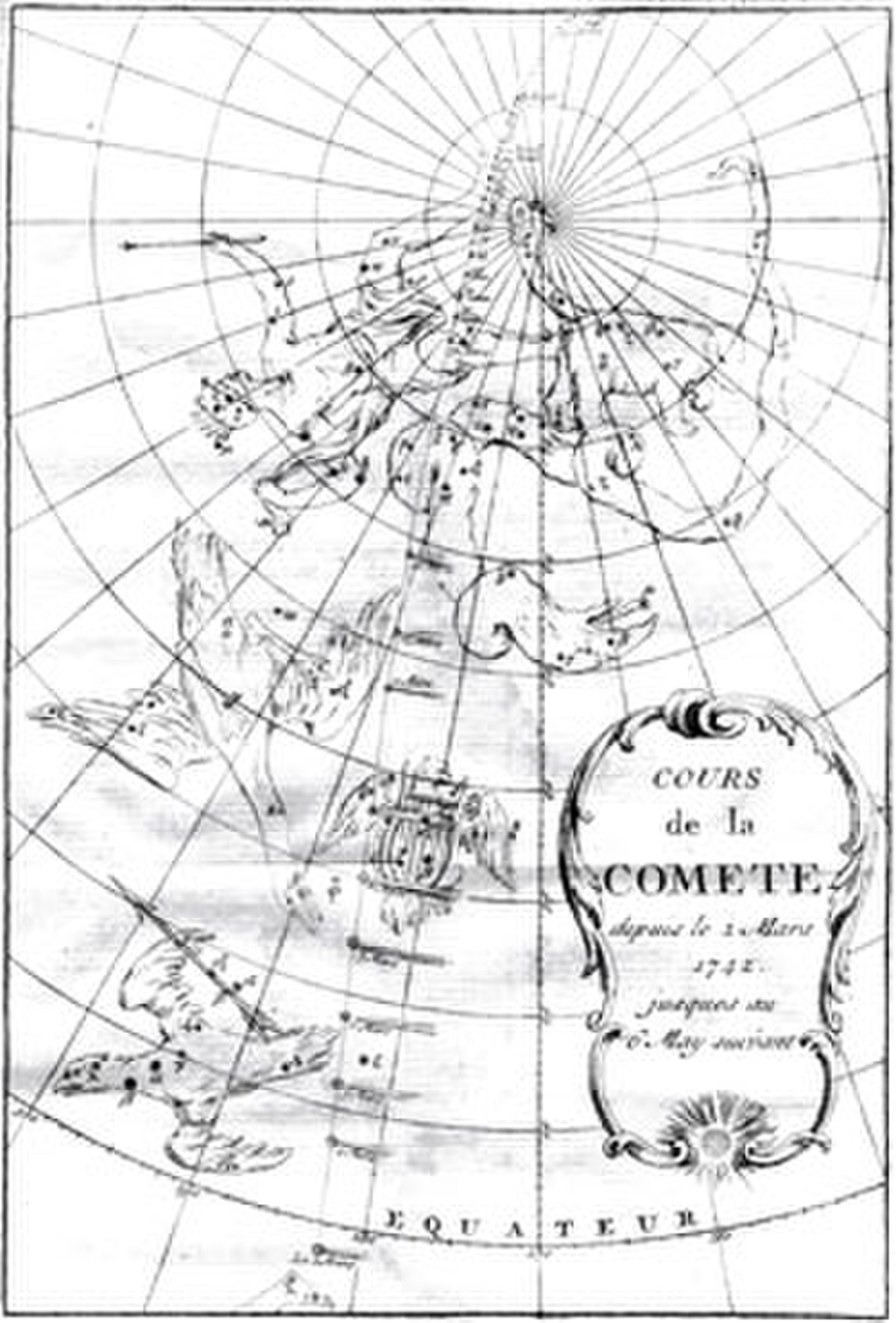

La physique est à l'origine d'équations fonctionnelles particulières : les systèmes dynamiques. Un exemple historiquement célèbre, est issu de la loi universelle de la gravitation. Si l'on néglige l'attraction due aux autres planètes, l'accélération de la Terre est dirigée vers le soleil et son intensité est inversement proportionnelle au carré de la distance qui sépare les deux astres. Cette loi physique se traduit par une équation qui, une fois connues la position et la vitesse initiales de la Terre, donne sa trajectoire, c'est-à-dire sa position en fonction du temps. Historiquement, la capacité à prévoir la position exacte des comètes au XVIIIe siècle fut une confirmation de la théorie de Newton.

Un système qui évolue et dont une équation permet de connaître exactement son état au cours du temps, à la condition de connaître son état initial, est qualifié de dynamique. On peut les classer en trois grandes catégories. La formulation la plus simple est dite discrète, l'état du système est décrit à différentes étapes, notées par les entiers 0, 1, 2 ..., k, ... et la solution est une suite (u k). Ce type de système est utilisé pour simuler un comportement continu, en discrétisant le temps à l'aide d'intervalles suffisamment petits pour que l'imprécision engendrées par cette méthode reste dans des limites acceptables. Connaître la trajectoire exacte d'une comète suppose la prise en compte de l'attraction de tous les corps célestes du système solaire. Résoudre l'équation dans ce cas devient difficile, on peut alors supposer qu'en une seconde, la gravité est presque constante, la trajectoire de la comète est presque parabolique et sa position au bout d'une seconde se calcule aisément, une fois connue la position des différents corps célestes massifs comme les planètes ou le soleil. Ensuite, il suffit de recalculer, à chaque seconde, la nouvelle attraction pour obtenir une suite donnant une approximation de la trajectoire réelle. Si (p k, v k) désigne le couple position et vitesse de la comète à la seconde k, il existe deux fonctions f et g régissant l'équation :

On obtient des suites définies par récurrence, caractéristique d'un système dynamique discret.

Il est aussi possible de s'y prendre autrement. Une relation lie la position de la comète avec sa vitesse instantanée (que l'on appelle dérivée en mathématiques) et son accélération (ou dérivée seconde). Résoudre l'équation permet de trouver la trajectoire de notre planète. L'équation prend une forme de la nature suivante, appelée équation différentielle :

Enfin, l'objectif peut être de déterminer l'état d'un objet qui ne se traduit non pas par un vecteur d'un espace de dimension finie, mais par une fonction, comme l'état d'une corde vibrante. On parle d'équation aux dérivées partielles.

Équation différentielle

La lettre x désigne ici une fonction de la variable réelle et f une fonction de n + 1 variables réelles. Soit F la fonction qui à x associe la fonction t —> f(t, x(t), x'(t), x(2)(t),..., x(n)(t)), où x(k) la dérivée kième de la fonction x. On considère l'équation F(x) = 0. Une telle équation est appelée équation différentielle.

Les solutions sont, en général, étudiées sous la « forme de Cauchy », c'est-à-dire associées à des valeurs t0 ,ξ0 ,ξ1,... ,ξn-1 telles qu'une solution vérifie :

La situation est un peu analogue à celle des équations polynomiales. Il existe une théorie des équations différentielles. Un premier résultat global est le théorème de Cauchy-Lipschitz, qui garantit que, si f est une fonction lipschitzienne, il existe une unique solution au problème de Cauchy. Résoudre le problème de Cauchy consiste à déterminer la solution d'une équation différentielle vérifiant une condition initiale donnée. Dans certains cas particuliers, il est possible d'expliciter directement une solution, comme pour l'équation différentielle d'ordre un à variables séparées ou l'équation différentielle linéaire, mais pas toujours.

L'exemple de droite illustre une solution d'une équation de la forme x' = φ(x), où la solution recherchée est une fonction définissant une courbe du plan. Sa variable est réelle et elle est à valeurs dans R2. La fonction φ est une fonction continue de R2 dans lui-même. À chaque point du plan, elle associe un vecteur, elle est dite champ vectoriel. Une solution s possède la propriété d'avoir, pour chaque point p de son image, une tangente à sa courbe de direction φ(p). La vitesse scalaire à l'instant t est égale à la norme de l'image par φ du point s(t).

Équation aux dérivées partielles

La physique propose divers exemples où la solution recherchée ne dépend pas d'une mais de plusieurs variables. Un cas relativement simple est celui d'une onde sur une corde vibrante. La fonction décrivant sa position dépend de deux paramètres, le temps et une coordonnée pour décrire un point de la corde. Trois variables sont nécessaire pour décrire une vague, deux décrivent la position d'un point de la surface et la troisième le temps. En physique quantique, la relation fondamentale de la dynamique se traduit par une équation d'onde qui nécessite quatre variables, trois pour l'espace et une pour le temps. Ce principe fondamental est appelée équation de Schrödinger.

L'équation équivalente à celle du paragraphe précédent, pour une fonction x de plusieurs variables, porte le nom d'équation aux dérivées partielles. L'équivalent du problème de Cauchy s'exprime de manière plus complexe. la condition initiale est remplacée par les conditions aux limites. Dans certains cas on recherche comme solution une fonction définie sur Ωx[a, b] ou Ω est un ouvert que l'on suppose borné, connexe et dont la frontière ∂Ω est régulière, [a, b] est un intervalle qui représente le temps . Les conditions aux limites s'expriment sous forme de deux contraintes. L'une correspond à la valeur ou la limite de la fonction sur ∂Ωx]a, b[. La fonction modélisant les mouvements d'une membrane de tambour est constante à la limite de la membrane, cette contrainte est appelée la condition aux limites de Dirichlet. Les valeurs de la fonction sur Ωx{a} sont appelées la condition initiale ou donnée de Cauchy.

En météorologie, la prévision numérique du temps consiste à modéliser les mouvements de l'atmosphère terrestre par l'équation de Navier-Stokes. Une difficulté pratique est de déterminer précisément la donnée de Cauchy : il faudrait mesurer la température, la pression, le taux d'humidité etc en tout point de l'atmosphère. Cette difficulté, ajoutée au fait qu'on ne sache pas résoudre l'équation de Navier-Stokes, font que les méthodes de résolution utilisées sont numériques : on ne peut calculer que des valeurs approchées.

Certaines équations aux dérivées partielles ne sont pas aussi complexes. Fourier, un mathématicien du début du XIXe siècle avait trouvé comment la chaleur se diffuse dans un corps solide dans le cas de conditions aux limites simples. La spécificité de cette équation, comme celle décrivant les ondes se propageant sur une corde vibrante est d'être linéaire, c'est-à-dire que l'on peut la mettre sous la forme a(x) + b = 0, où a est un opérateur linéaire construit à l'aide de dérivées partielles et b une fonction particulière. Le cas linéaire est traité par une théorie « relativement bien constituée ». L'outil principal est un espace fonctionnel particulier, dit de Sobolev.

D'autres équations restent difficiles d'accès. La surface d'un océan est aussi modélisée par une équation aux dérivées partielles. Comme le laisse penser la forme d'une vague, l'expression d'une solution peut s'avérer difficile. On est loin de disposer d'une théorie générale, les deux paragraphes suivant indiquent le type de difficulté à résoudre pour comprendre les systèmes dynamiques.

Condition initiale

Une des questions qui se pose sur les systèmes dynamiques est la nature de la solution en fonction de sa valeur initiale. Si une petite modification de cette valeur change de manière importante le comportement de la solution, même si le système est déterministe, son évolution semblera aléatoire. Si "déterministe" signifie que toute évolution du système dépend uniquement de sa valeur initiale, sa connaissance parfaite permet de prévoir parfaitement son futur, ce qui est toujours le cas d'un système dynamique idéalisé. En physique, il est impossible de connaître parfaitement l'état initial du système. On le connaît, par exemple avec une précision de 5 décimales, si la sixième décimale finit par modifier l'évolution du système de manière significative, le futur de l'évolution n'est pas connu (il est même indéterminable), mais dépend d'une information inaccessible parce que idéalisée. Le futur apparaît alors comme incertain, même si les lois modélisant l'évolution sont "déterministes". On voit donc ici les limites de la modélisation. Ce phénomène se produit en météorologie, cette science est modélisée par un système dynamique qui, pour permettre une prévision sur le long terme, demande une connaissance précise de l'état initial. Comme cette connaissance est d'une précision limitée, il existe un horizon (ou plutôt des horizons plus ou moins divergents) dans la prévision. Si l'équation modélisant la météorologie est bien connue, on ne sait toujours pas si les solutions dépendent continûment de valeurs aux bornes du domaine de la solution (l'équivalent de la condition initiale pour une équation aux dérivées partielles), cette question est associée à l'un des sept prix de un million de dollars offerts par l'Institut de mathématiques Clay au premier qui apportera la réponse.

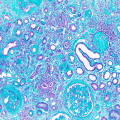

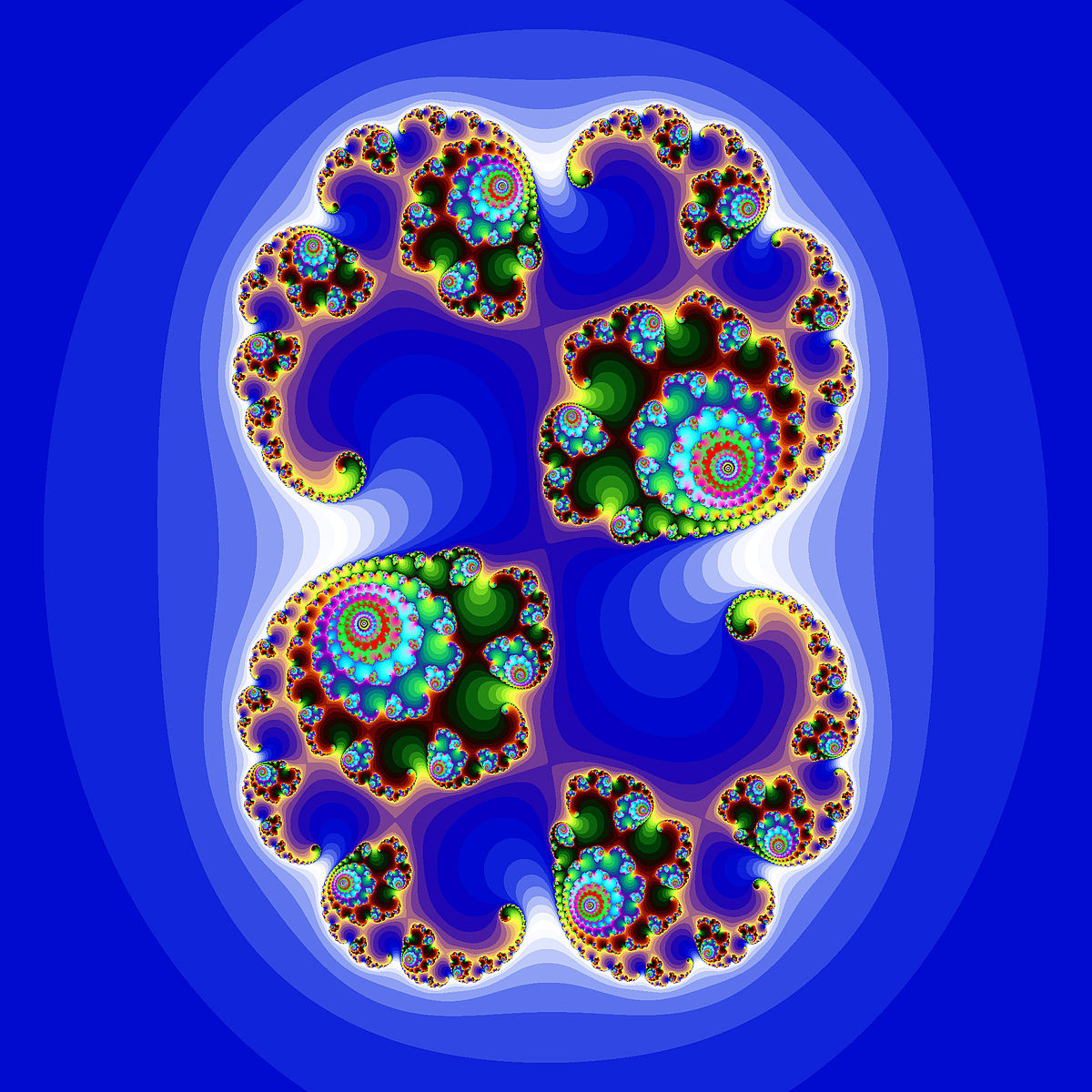

Une méthode pour apporter des éléments de réponse, est d'étudier les cas les plus simples possibles. On cherche à comprendre ce phénomène sur une suite récurrente définie par l'équation : xn+1 = f(xn) où f est un polynôme du second degré, réel ou complexe. Un cas très étudié est celui où f(x) = x2 + c. La condition initiale est ici la valeur de x0, un nombre complexe. Jc est l'ensemble des conditions initiales telles que la suite est bornée, il est appelé ensemble de Julia, dont un exemple est illustré sur la figure de gauche. Toute condition initiale p hors de la frontière de Jc possède un voisinage ne contenant que des conditions initiales dont le comportement des suites sont qualitativement analogues. Les couleurs indiquent les valeurs de convergence, l'intensité symbolise la vitesse de convergence.

Une première question qui se pose est le poids de la zone frontière. Sur cette zone, il existe toujours une perturbation de la condition initiale, aussi minime soit-elle, qui modifie la nature de la solution. Dans les configurations classiques, une frontière d'une figure géométrique de dimension 2 est d'aire nulle, même si la figure possède une aire strictement positive. Ainsi, un disque de rayon strictement positif est d'aire strictement positive et sa frontière, un cercle de même rayon, est d'aire nulle. En revanche, le cercle, considéré comme une courbe, possède une longueur finie. Pour la frontière de l'ensemble de Julia, cette méthode s'avère parfois inopérante, on peut trouver une longueur infinie, si la frontière est considérée comme une courbe. Pour évaluer le poids de cette longueur, on utilise une remarque géométrique. Soit S une surface d'aire s, l'homothétie de rapport 2 appliquée à S, définit une nouvelle surface d'aire 22.s. Si V est une figure géométrique de dimension 3 et de volume v, l'homothétie de rapport 2 définit une figure de volume 23.v. L'exposant que l'on applique au rapport de l'homothétie indique la dimension de la figure, ce qui, d'une certaine manière permet une évaluation du poids de la figure, on parle de dimension de Hausdorff ou de dimension fractale. Cette technique peut être appliquée à la frontière de l'ensemble de Julia, sa dimension est génériquement différente de un : la frontière est dite fractale.

Chaos

La sensibilité à la condition initiale n'est pas l'unique question à résoudre pour élaborer une théorie générale des systèmes dynamiques. On souhaite aussi connaître le comportement limite du système, encore appelé comportement asymptotique, c'est-à-dire ce qu'il se passe une fois que l'on a attendu que le système se stabilise. S'il ne diverge pas, on peut classer son comportement en trois catégories, soit le système s'immobilise, soit il tend vers un cycle, soit vers encore autre chose qui, selon certaines définitions, est appelée chaos.

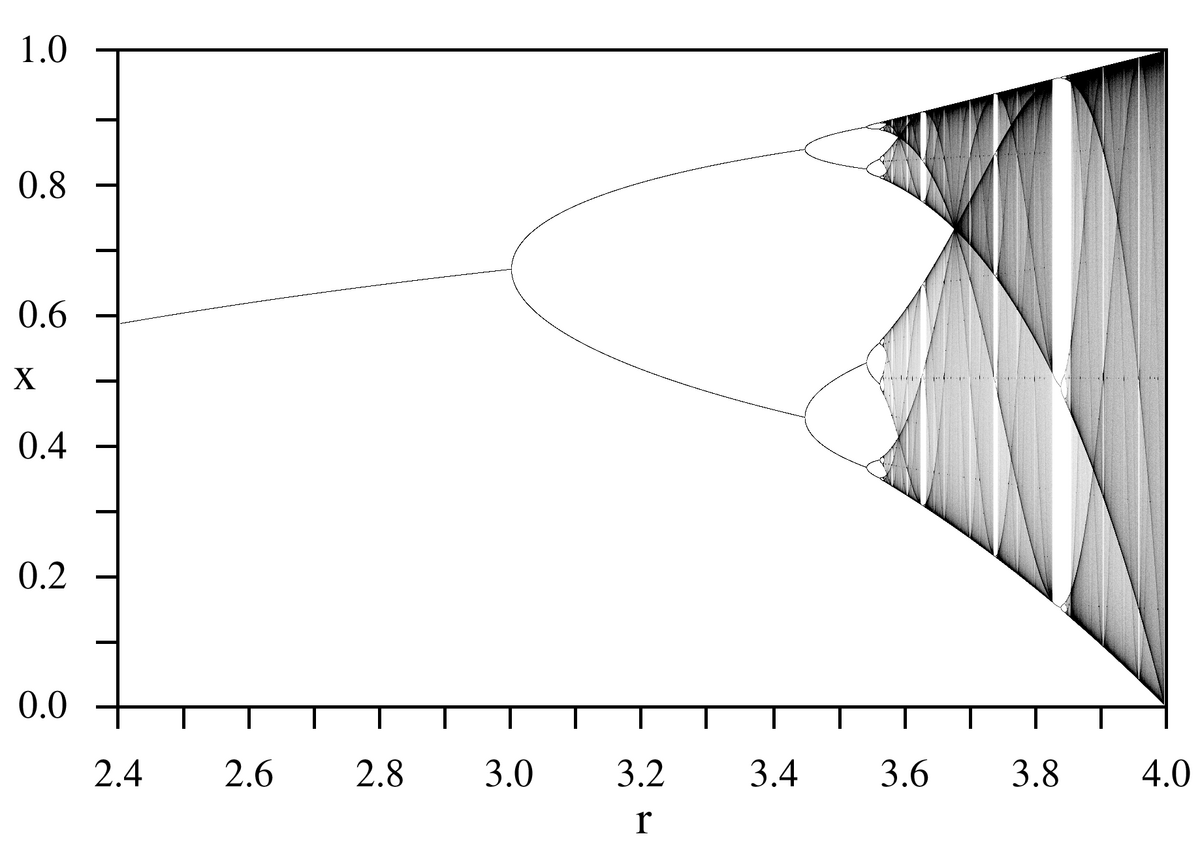

Une fois encore, il est utile de considérer le système dynamique le plus simple possible, pour comprendre au moins qualitativement les mécanismes en jeu. Comme précédemment, on utilise une suite récurrente définie par un polynôme du second degré Pr, cette fois-ci réel à valeurs réelles. La suite logistique est définie par récurrence : xr,n+1 = r.xr,n.(1 - xr,n). L'un des charmes de cette suite est que son comportement est relativement indépendant de la condition initiale si elle est choisie entre 0 et 1.

L'objectif est d'augmenter la valeur de r, initialement nulle et d'étudier ce comportement asymptotique. Si une fonction f possède un point fixe pf, de dérivée strictement comprise entre -1 et 1, en valeur absolue, et si la suite définie par xn+1 = f(xn) prend une valeur proche de ce point fixe, elle converge vers pf. Ce point est dit attracteur et la zone des valeurs initiales dont les suites convergent vers ce point est appelée bassin d'attraction. Pour une suite logistique le bassin d'attraction principal contient toujours ]0, 1[, à un ensemble négligeable près, quelle que soit la valeur de l'attracteur. La suite semble être attirée, comme par un aimant vers cet attracteur. Si r est compris entre 0 et 3, l'attracteur est un point et la suite converge. A partir de la valeur 3, le polynôme Pr ne possède plus de point fixe, mais le polynôme composé avec lui-même, en possède un, si r est suffisamment petit. Le comportement asymptotique de la suite est une oscillation entre les deux points fixes attractifs de Pr2. La valeur 3 de r est appelée une bifurcation. L'attracteur devient un ensemble à deux éléments, illustré sur la figure de droite. Au point 1+√6, une nouvelle bifurcation se produit, l'attracteur possède alors 4 points. Le cardinal de l'attracteur augmente de plus en plus en fonction de r par des doublements, jusqu'à atteindre une valeur infinie pour r égale à μ, qui se situe aux alentours de 3,57.

Il devient nécessaire de préciser ce qu'on entend par « attracteur » : ce sera l'intersection des ensembles An où An est l'adhérence des points x k pour k supérieur à n. Dans le cas de la suite logistique et à l'exception d'un ensemble de mesure nulle, l'attracteur est indépendant de la condition initiale. On peut voir l'attracteur Ar comme un ensemble qui attire les éléments de la suite, laquelle, à partir d'un certain rang, devient arbitrairement proche de A. Entre μ et 4, un triple comportement est possible. Pour un ensemble H (pour hyperbolique) de valeurs du paramètre r qui est un ouvert dense de [μ, 4], l'attracteur est un ensemble fini (comportement cyclique). Pour un autre ensemble C (pour chaotique) de valeurs du paramètre, qui est lui fermé, totalement discontinu et de mesure strictement positive, pour presque toutes valeurs initiales x0 (dépendant de r) l'attracteur est un intervalle d'intérieur non vide et le comportement est chaotique, c'est-à-dire qu'il évolue sans ordre apparent, à l'exception d'un ensemble de mesure nulle, semblant évoluer au gré du hasard, même si cette évolution est en fait déterministe. Le dernier comportement se produit sur l'ensemble A, complémentaire de l'union de C et de H dans [μ, 4]. L'ensemble A n'est pas vide, le comportement est alors plus complexe et fait intervenir, comme attracteur, des ensembles de Cantor. Depuis 2002, on sait que A est de mesure nulle.

Ce comportement s'applique aussi aux équations différentielles ou aux dérivées partielles. Edward Lorenz a trouvé une équation différentielle relativement simple, ayant un attracteur fractal, généralement qualifié d'étrange, il est représenté sur la deuxième illustration de cet article. Certaines équations différentielles ne peuvent avoir de solutions si complexes, le théorème de Poincaré-Bendixson montre une famille d'équations n'ayant pas de comportement chaotique. Des solutions chaotiques complexes apparaissent aussi dans les équations aux dérivées partielles, on les trouve dans les modélisations des mouvements des masses d'air, par exemple autour des ailes d'avion, elles prennent la forme de turbulences. En 2009, l'état des mathématiques est loin d'être capable de présenter une condition nécessaire et suffisante générale, indiquant si oui ou non un comportement chaotique apparaît, même dans le cas des systèmes discrets.